엔비디아 젠슨 황 CEO가 삼성전자 HBM (고대역폭메모리) 제품이 엔비디아 제품에 탑재될 것이라고 밝혔는데요, 이는 최근 이슈되었던 삼성 HBM 품질 테스트 실패 관련 루머에 대해 사실이 아님을 밝히며 엔비디아에 삼성전자의 HBM 제품이 납품될 것으로 예상됩니다.

이와 관련된 해당 기사가 궁금하신 분들은 여기 기사를 클릭하여 주세요.

그렇다면 과연 HBM 이란 무엇일까요? 무엇이길래 지금 이 시대에 중요한 재원으로 손꼽히고 있을까요? 오늘은 이것에 대해 알아보도록 하겠습니다.

HBM 이란?

HBM(High Bandwidth Memory)은 고대역폭 메모리 기술로, 주로 그래픽 카드와 하이엔드 컴퓨팅 시스템에서 사용됩니다.

이 기술은 기존의 GDDR 메모리(GDDR5, GDDR6 등)에 비해 훨씬 더 높은 대역폭을 제공함으로써, 데이터를 더 빠르게 처리할 수 있게 해 줍니다.

2010년대 초반 대한민국 SK하이닉스에서 최초로 개발하여 양산한 적층형 메모리 반도체로서, 초반에는 GDDR 메모리 반도체에 비해 뚜렷하게 우세하지 못한 성능과 고가의 가격으로 인해 계륵으로 취급받았습니다.

이러했던 HBM의 수요가 급증했던 이유는 무엇일까요? 그것을 이해하기 위해서는 먼저 메모리 반도체 성능 구성요소를 살펴봐야 합니다.

메모리 반도체 성능 구성요소

메모리 반도체의 성능은 용량과 속도에 의해 정해집니다.

여기서 용량은 실제 메모리 내에 저장할 수 있는 데이터의 양으로 테라 바이트나 기가바이트 등의 용량으로 구분할 수 있으며, 메모리 반도체의 속도는 메모리 반도체 내의 반응속도 및 한 번에 빼낼 수 있는 데이터의 양을 얘기합니다. 이때 이것을 대역폭이라고 합니다.

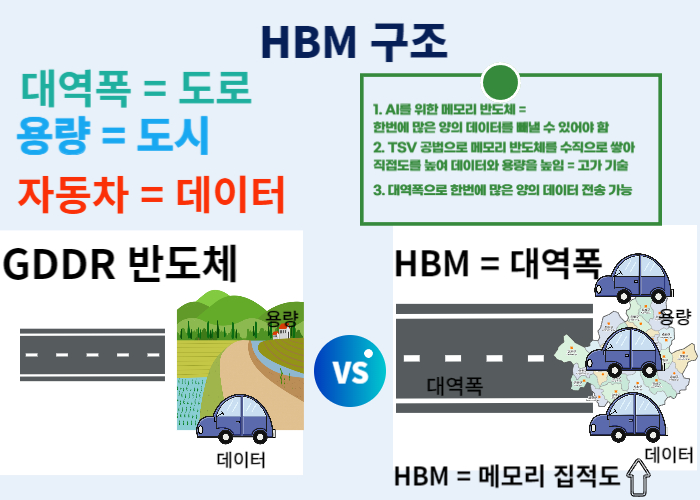

예컨대, 도로 = 대역폭 / 용량 = 도시 / 자동차 = 데이터라고 가정해 봅시다. 기존의 GDDR 메모리 반도체에 비해 HBM은 더 넓은 도로로 자동차가 훨씬 더 많이 빠져나갈 수 있고, 도시의 기술적 발달로 인해 더 많은 자동차를 효과적으로 저장할 수 있습니다.

HBM 구조

HBM은 여러 개의 메모리 뱅크를 수직으로 쌓아 올린 3D 스택 구조를 가지고 있습니다. 이러한 3D 스택 구조 덕분에, 같은 공간에서 더 많은 데이터를 저장하고 처리할 수 있습니다.

또한, 메모리 칩 사이의 짧은 연결 거리는 데이터 전송 속도를 향상하고, 전력 소비를 줄여줍니다.

HBM의 장점

- 고대역폭: HBM은 기존 메모리 기술(GDDR5, GDDR6 등)에 비해 훨씬 높은 대역폭을 제공합니다. 이를 통해 데이터 처리 속도가 크게 향상됩니다.

- 에너지 효율: HBM은 낮은 전력으로 높은 성능을 낼 수 있습니다. 이는 에너지 비용 절감과 함께 환경에도 긍정적인 영향을 미칩니다.

- 공간 효율: 3D 스택 구조로 인해, 칩 간의 데이터 전송 속도가 짧아 제한된 공간에서도 높은 용량과 성능을 제공할 수 있습니다.

- 낮은 지연 시간: 메모리 칩 사이의 짧은 연결 거리는 데이터 전송 시간을 줄여, 전체 시스템의 지연 시간을 감소시킵니다. 이는 실시간 처리에 유리합니다.

HBM의 사용 분야

주로 고성능 컴퓨팅(HPC), 그래픽 처리 장치(GPU), 네트워킹 장비, 데이터 센터 등의 분야에서 사용됩니다. 특히, 고해상도 비디오 게임, 가상현실, 인공 지능 연산, 빅 데이터 분석과 같은 데이터 집약적인 작업에서 그 성능을 발휘합니다.

또한 AI 시대에서 HBM은 높은 대역폭, 낮은 지연 시간, 에너지 효율성, 공간 효율성 등의 특성 덕분에 매우 중요한 역할을 합니다.

이러한 특성은 AI 응용 분야에서 요구되는 고속 데이터 처리와 실시간 반응을 가능하게 하여, 인공지능 기술의 발전을 가속화하고 보다 효율적인 시스템을 구축하는 데 기여합니다.

최근 엔비디아 매출 및 주가가 급증하면서 AI반도체에 필요한 HBM 수요 또한 급증하고 있습니다. SK 하이닉스 및 삼성전자 등 반도체 제조업체 또한 피 튀기는 경쟁과 호황을 함께 누리고 있는데요,

엔비디아 성장에 수혜를 입을 수 있는 엔비디아 관련주 및 수혜를 얻을 수 있는 기업에 대해 궁금하신 분들은 아래의 포스팅을 참고하여 주세요.

엔비디아 주가 시가총액 3조 달러 돌파 엔비디아 실적 및 관련주 5

엔비디아 주가가 3조 (4,135조 원) 달러를 돌파하며 애플을 제치고 세계 2위 기업으로 등극했는데요, 이는 전 세계 기업 중 세 번째로 3조 달러에 도달한 기업이 됐습니다. 국내 기업인 삼성전자의

vagabonder.tistory.com

인공지능 AI 시대 HBM의 중요성

AI 기술, 특히 딥러닝과 머신러닝 알고리즘은 방대한 양의 데이터를 처리해야 합니다. 예를 들어, 이미지 인식, 자연어 처리, 자율 주행 등 다양한 AI 응용 분야에서는 고속 데이터 처리와 실시간 반응이 필수적입니다.

이러한 데이터를 빠르게 처리하려면 고성능 컴퓨팅 파워와 높은 대역폭의 메모리가 필요합니다.

- 딥러닝 모델 훈련 가속화: 딥러닝 모델을 훈련하려면 대량의 데이터와 복잡한 계산이 필요합니다. HBM은 고대역폭과 낮은 지연 시간을 제공하여 데이터 전송과 처리 속도를 크게 향상합니다. 이는 모델 훈련 시간을 단축시키고 더 빠른 결과를 제공합니다.

- 실시간 데이터 처리: 자율 주행, 실시간 영상 분석 등 실시간 처리가 필요한 AI 응용 분야에서는 데이터 전송 지연이 최소화되어야 합니다. HBM은 낮은 지연 시간 덕분에 실시간 데이터 처리가 가능하게 합니다.

- 에너지 절약: AI 연산은 많은 전력을 소비합니다. HBM의 에너지 효율성은 전력 소모를 줄여 비용 절감과 환경 보호에 기여합니다.

- 확장성: AI 기술이 발전함에 따라 데이터와 연산 요구 사항도 증가합니다. HBM은 공간 효율성이 높아 시스템 확장이 용이합니다.

감사합니다.